Inligtingsteorie Entropie

In Inligtingsteorie, is die entropie van 'n ewekansige veranderlike die gemiddelde vlak van inligting, verrassing of onsekerheid ingebore aan die veranderlike se moontlike uitkomste.

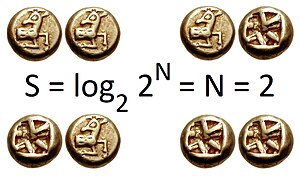

Gegewe 'n diskrete ewekansige veranderlike , met moontlike uitkomste , wat met waarskynlikheid plaasvind, die entropie van word formeel gedefinieer as:

waar dui die som bo die veranderlike se moontlike waardes aan. Die keuse van basis vir , die logaritme, verskil vir verskillende toepassings. Basis 2 gee die eenheid van bis (of "shannons"), terwyl basis e gee "natuurlike eenhede" nat, en basis 10 gee eenhede van "dits", "bans", of "hartleys". 'n Ekwivalente definisie van entropie is die verwagte waarde van die selfinligting van 'n veranderlike.

Die konsep van inligtingsentropie is deur Claude Shannon bekendgestel in sy 1948-artikel "A Mathematical Theory of Communication", en word ook na verwys as Shannon-entropie.

Sien ook

Verwysings

This article uses material from the Wikipedia Afrikaans article Entropie (Inligtingsteorie), which is released under the Creative Commons Attribution-ShareAlike 3.0 license ("CC BY-SA 3.0"); additional terms may apply (view authors). Inhoud is onderhewig aan CC BY-SA 4.0, tensy anders vermeld. Images, videos and audio are available under their respective licenses.

®Wikipedia is a registered trademark of the Wiki Foundation, Inc. Wiki Afrikaans (DUHOCTRUNGQUOC.VN) is an independent company and has no affiliation with Wiki Foundation.